Adobe wagt es, künstliche Intelligenz mit Initiativen für Vielfalt, Gleichberechtigung und Integration (DEI) zu verbinden. Aber ist das wirklich sicher?

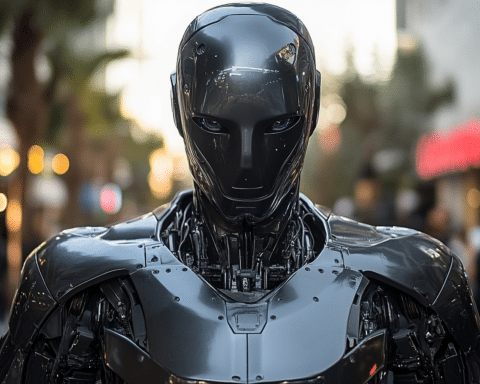

Adobes bevorstehendes Patent dreht sich um ein „Diversity Auditing“-System, das sich die Computer Vision Technologie zunutze macht. Die Voraussetzung dafür sind Gesichtserkennung und Bildsortierfunktionen, um die Fotos von Mitarbeitern anhand bestimmter physischer Merkmale zu kategorisieren.

Der Mechanismus prüft zahlreiche Bilder, um Gesichter zu erkennen. Anschließend wird jedes Gesicht in Bezug auf ein voraussichtliches „sensibles Merkmal“ klassifiziert, das mit „geschützten Personengruppen“ in Verbindung gebracht wird, die sich auf Faktoren wie Rasse, Alter oder Geschlecht beziehen können. In einer Illustration von Adobe wird vorgeschlagen, dass das System Bilder von einer Unternehmenswebsite auswerten und seine Schlussfolgerungen einer „Vergleichspopulation“ gegenüberstellen könnte, die offizielle Volkszählungsdaten, Job-Metriken oder sogar das interne Diversitätsdossier des Unternehmens umfassen könnte.

Mithilfe von maschinellem Lernen wird nach dem Vergleich der kategorisierten Bilder mit der Referenzpopulation ein „Diversity Score“ ermittelt. Das System geht noch einen Schritt weiter, indem es die Bildersammlung erweitert, um über „zusätzlich beschaffte Bilder“ eine vordefinierte Diversitäts-Benchmark zu erreichen.

Während herkömmliche Tools für die Prüfung der Vielfalt einen erschöpfenden manuellen Aufwand erfordern und für umfangreiche Bildstapel nicht skalierbar sind, bietet Adobe eine optimierte Lösung an.

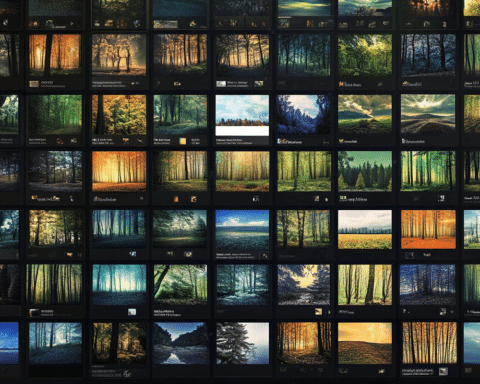

Mukul Dhankhar, der Visionär hinter dem Computer Vision Unternehmen Mashgin, hat jedoch einige Vorbehalte geäußert. Die Extraktion von Diversitätsmetriken aus Bildern ist kompliziert. Er bezweifelt die Richtigkeit der Bestimmung von Alter, Geschlecht oder Rasse allein anhand von visuellen Merkmalen. Darüber hinaus werden die Nuancen von multirassischen oder geschlechtsuntypischen Identitäten in dem Vorschlag nicht ausdrücklich angesprochen.

Dhankhar führt aus: „Das Patent erwähnt einen einzigen Diversitätswert. Doch Vielfalt hat viele Facetten.“ Er fordert Adobe auf, darüber nachzudenken, wie das Model eine von Männern dominierte Bildserie mit verschiedenen Ethnien interpretieren wird, oder wie es auf stereotype Darstellungen reagiert.

Darüber hinaus sollte Adobe mit seinem Patent sicherstellen, dass das KI-System frei von inhärenten Voreingenommenheiten ist – Voreingenommenheiten, die unbeabsichtigt von seinen Entwicklern stammen könnten. „Der Vorschlag enthält keine Maßnahmen zur Gewährleistung der Unparteilichkeit des Modells“, bemerkt Dhankhar.

Dennoch erkennt Dhankhar an, wie vielversprechend diese Technologie ist. Wenn es mit Bedacht eingesetzt wird, könnte es als Werkzeug dienen, um die Inklusivität von Datensätzen für das KI-Training zu überprüfen. Und wenn es über visuelle Daten hinausgeht und auch Textinformationen einbezieht, könnten seine Anwendungen sogar noch revolutionärer sein.

Dhankhar schlussfolgert: „Datenverzerrungen zu erkennen ist lobenswert, aber dieses Patent erfordert ein tieferes Eintauchen in die Spezifika.“

Adobes Integration von KI in den Bereich der DEI signalisiert eine breitere Verlagerung hin zur Nutzung von Technologie für integrative Praktiken. Das vorgeschlagene System verspricht zwar Effizienz und Skalierbarkeit, aber die Feinheiten der Vielfalt erfordern eine sorgfältige Handhabung. Wie bei vielen technologischen Lösungen wird der Schlüssel darin liegen, sicherzustellen, dass die Interpretation der KI von Vielfalt so vielfältig und umfassend ist wie die menschliche Realität, die sie abbilden soll. Unternehmen wie Adobe stehen an der Schnittstelle zwischen Innovation und Ethik und unterstreichen damit die überragende Bedeutung einer durchdachten Technologieanwendung in sensiblen Bereichen.