Große Tech-CEOs, darunter auch Mark Zuckerberg von Meta, sehen sich erneut einer Untersuchung des Kongresses über den potenziellen Schaden ausgesetzt, den soziale Medienplattformen bei Teenagern anrichten. Wachsende Bedenken bringen diese Plattformen mit Problemen wie Depressionen und Selbstmordgedanken bei jungen Nutzern in Verbindung.

Die Gesetzgeber in Washington, D.C. fordern von den Tech-Giganten konkrete Maßnahmen, die über ihre üblichen Versprechen hinausgehen, Jugendliche und Eltern zu befähigen, verantwortungsvolle Entscheidungen im Internet zu treffen. Angesichts der bevorstehenden Präsidentschaftswahlen und der Tatsache, dass die Gesetzgeber der Bundesstaaten die Führung übernehmen, drängt der Kongress auf substanziellere Anstrengungen, um diese Probleme anzugehen.

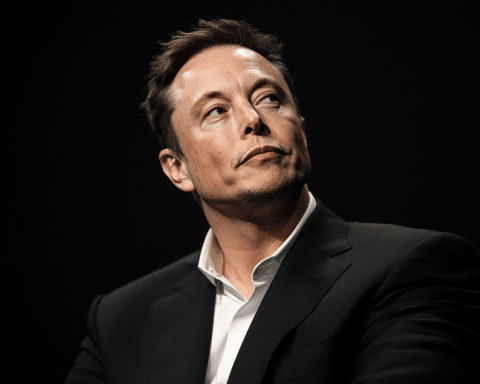

Neben Mark Zuckerberg werden die CEOs von TikTok, Snap, Discord und X bei der Anhörung des Justizausschusses des Senats aussagen. Für einige, darunter Linda Yaccarino, CEO von X, Evan Spiegel, CEO von Snap, und Jason Citron, CEO von Discord, ist es der erste Auftritt vor dem Kongress.

Diese Tech-CEOs wollen die Tools und Richtlinien ihrer Plattformen hervorheben, die dem Schutz von Kindern dienen und ihnen mehr elterliche Kontrolle über ihre Online-Erfahrungen bieten. Unternehmen wie Snap und Discord distanzieren sich von Metas Ansatz, indem sie betonen, dass sie nicht auf süchtig machende oder schädliche, algorithmisch empfohlene Inhalte setzen.

Kritiker, darunter Eltern und Befürworter der Online-Sicherheit, argumentieren jedoch, dass diese Tools zu kurz greifen und Eltern und jungen Nutzern zu viel Verantwortung auferlegen. Sie glauben, dass man sich nicht mehr darauf verlassen kann, dass sich die Technologieplattformen selbst regulieren.

Experten fordern den Kongressausschuss auf, auf signifikante Änderungen zu drängen, wie z.B. die Abkopplung von Werbe- und Marketingsystemen von Diensten, die sich an Jugendliche richten. Der Aufstieg der generativen künstlichen Intelligenz hat die Notwendigkeit von Standard-Sicherheitsfunktionen auf Technologieplattformen noch dringlicher gemacht.

Mehrere große Plattformen, darunter Meta, Snapchat, Discord und TikTok, haben Aufsichtstools eingeführt, mit denen Eltern die Online-Aktivitäten ihrer Teenager überwachen und die Kontrolle ausüben können. Einige Plattformen wie Instagram und TikTok haben Funktionen wie „Mach mal Pause“-Erinnerungen und Bildschirmzeitbegrenzungen eingeführt, um Jugendliche vor schädlichen Inhalten zu schützen.

Meta hat vor kurzem ein Bundesgesetz vorgeschlagen, das vorsieht, dass App-Stores und nicht die Unternehmen der sozialen Medien das Alter der Nutzer überprüfen und Altersbeschränkungen durchsetzen müssen. Sie kündigten auch verschiedene Jugendschutzmaßnahmen an, darunter das Ausblenden von „altersunangemessenen Inhalten“ aus den Feeds von Teenagern und die Förderung strengerer Sicherheitseinstellungen.

Snapchat hat sein Tool für die elterliche Aufsicht, das Family Center, erweitert und bietet Eltern damit mehr Kontrolle über die Interaktionen ihrer Teenager mit der App.

Diese Anhörung ist die jüngste in einer Reihe von Auftritten führender Vertreter der Technologiebranche im Kongress, die zum Teil auf die Enthüllungen der Facebook-Whistleblowerin Frances Haugen Ende 2021 zurückzuführen sind. Während einige Aktualisierungen begrüßt wurden, argumentieren Kritiker, dass sie den Eltern immer noch zu viel Verantwortung aufbürden. Sie sind der Meinung, dass die Verzögerung bei der Umsetzung von Sicherheitsupdates durch die Technologiebranche zeigt, dass die Selbstregulierung nicht mehr wirksam ist.

Technologieunternehmen versuchen, ein Gleichgewicht zwischen Sicherheit und Selbstbestimmung für junge Nutzer herzustellen und gleichzeitig strenge Inhaltsvorgaben zu vermeiden. In der Zwischenzeit wächst die Dynamik für eine Regulierung der sozialen Medien außerhalb des Kongresses. Mehrere Bundesstaaten, darunter Arkansas, Louisiana, Ohio und Utah, haben Gesetze erlassen, die die Nutzung sozialer Medien durch Jugendliche einschränken, wobei einige die Zustimmung der Eltern für minderjährige Konten verlangen. Rechtliche Anfechtungen der Tech-Industrie berufen sich auf potenzielle Bedrohungen der Rechte des ersten Verfassungszusatzes und der Privatsphäre.

Die Klagen von Staaten und Verbrauchern gegen Technologieunternehmen nehmen zu und erhöhen den Druck auf eine strengere Regulierung. Die Anhörung bietet den Gesetzgebern die Gelegenheit, kleinere Branchenakteure wie X und Discord zu ihren Bemühungen um den Jugendschutz zu befragen.

Da die Forderungen nach branchenweiten Lösungen immer lauter werden, wird die Anhörung am Mittwoch zu einem entscheidenden Moment bei der Gestaltung der Zukunft der Kindersicherheit auf sozialen Medienplattformen.