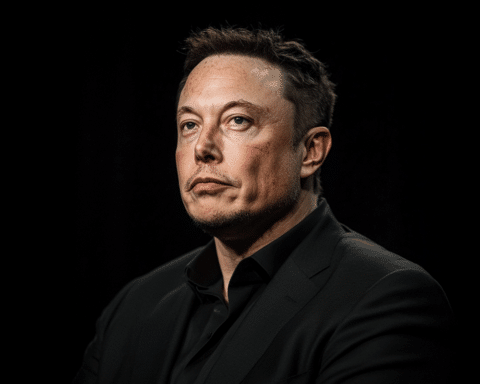

In einer bahnbrechenden Studie unter der Leitung der Australian National University (ANU) wurde aufgedeckt, dass die künstliche Intelligenz (KI) ein Stadium erreicht hat, in dem sie weiße Gesichter erzeugt, die authentischer erscheinen als echte menschliche Gesichter. Diese Entdeckung deutet auf einen bedeutenden Fortschritt in den Fähigkeiten der KI hin, zeigt aber auch eine bedenkliche Verzerrung auf.

Das Forschungsteam hat die Aufmerksamkeit auf die Tatsache gelenkt, dass die Fähigkeit der KI, weiße Gesichter zu erzeugen, sich nicht auf Gesichter von Menschen anderer Hautfarbe erstreckt. Der Grund für diese Diskrepanz liegt darin, dass die KI vorwiegend auf weiße Gesichter trainiert wurde, was zu einer digitalen Kluft führt. Dieser Unterschied im Realismus könnte tiefgreifende Auswirkungen haben und rassistische Vorurteile in der Online-Sphäre möglicherweise noch verstärken.

Einer der beunruhigenderen Aspekte der Studie zeigt, dass der Hyperrealismus der KI zu einem Paradoxon führt, bei dem Personen, die am ehesten von KI-generierten Gesichtern getäuscht werden können, auch am sichersten in der Lage sind, echte Gesichter von künstlichen zu unterscheiden. Diese Selbstüberschätzung könnte sie anfälliger dafür machen, von KI-Betrügern in die Irre geführt zu werden.

Weitere Erkenntnisse aus der Studie deuten darauf hin, dass es zwar immer noch erkennbare physische Unterschiede zwischen KI-generierten Gesichtern und tatsächlichen menschlichen Gesichtern gibt, die öffentliche Wahrnehmung jedoch verzerrt ist. Proportionale Merkmale in weißen, KI-generierten Gesichtern werden oft als natürliche menschliche Eigenschaften fehlinterpretiert und nicht als das Produkt eines Algorithmus.

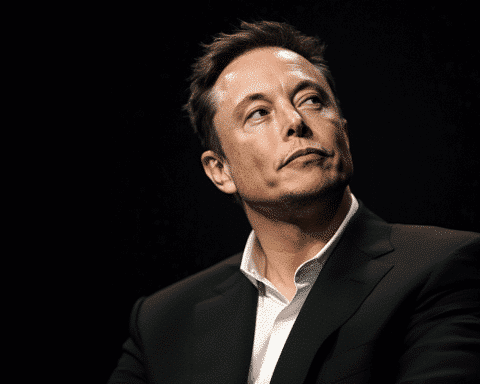

Dieser rasante Fortschritt in der KI-Technologie wird die Grenzen zwischen real und synthetisch bis zu einem ununterscheidbaren Grad verschwimmen lassen. Dies gibt Anlass zur Sorge über das Missbrauchspotenzial für die Verbreitung von Fehlinformationen und Identitätsdiebstahl. Die Leichtigkeit, mit der KI-generierte Bilder erstellt und online verbreitet werden können, könnte zu einem Werkzeug für irreführende Informationskampagnen werden, wenn sie nicht kontrolliert werden.

Die ANU-Forscher haben dringende Maßnahmen gefordert, um eine Eskalation dieser Risiken zu verhindern. Sie argumentieren, dass mehr als nur technologische Innovation nötig ist; Transparenz ist der Schlüssel. Es ist von entscheidender Bedeutung, dass nicht nur Technologieunternehmen, sondern auch die breite Öffentlichkeit die Mechanismen hinter KI versteht, um Probleme zu erkennen und proaktiv anzugehen.

Die Studie betont, wie wichtig es ist, die Öffentlichkeit für KI-generierte Bilder zu sensibilisieren. Da es für den Einzelnen immer schwieriger wird, zwischen KI-generierten und echten Gesichtern zu unterscheiden, benötigt die Gesellschaft robuste Werkzeuge und Strategien, um KI-Betrüger zu erkennen und zu kennzeichnen.

Je weiter sich die KI entwickelt, desto dringlicher wird die Aufklärung über die Möglichkeiten und den möglichen Missbrauch dieser Technologie. Die Öffentlichkeit muss mit dem Wissen ausgestattet werden, Online-Bildern mit einer gesunden Portion Skepsis zu begegnen, damit sie sich sicher und informiert in der digitalen Welt bewegen kann.